Zhipu GLM-4.7 на Huawei Ascend: Китай показал frontier-модель без единого NVIDIA

Zhipu обучила GLM-4.7 на 100 000 Huawei Ascend 910B и опубликовала технический отчёт. Разбираем стек MindSpore + Ascend и что это значит для экспортного контроля.

Год назад экспортные ограничения США выглядели как стратегический рычаг: без H100 и H200 у китайских лабораторий не было шанса тренировать конкурентоспособные модели. На этой неделе Zhipu опубликовала технический отчёт по GLM-4.7, в котором подтвердила то, о чём индустрия шепталась с зимы: вся frontier-линейка компании, включая текущий флагманский GLM-4.7 и его наследников, тренируется исключительно на Huawei Ascend — без единого NVIDIA-чипа в стеке. И при этом модель остаётся в десятке лучших опен-сорс LLM мира.

Что произошло

Zhipu попала в Entity List США в январе 2025 года. Это перекрыло легальный доступ к Nvidia H100, H200 и B200 — стандартному стеку для тренировки frontier-моделей. У компании было два варианта: тихо использовать серый импорт через посредников или полностью переехать на отечественное железо. Zhipu выбрала второе и за год построила тренировочный кластер на 100 000 процессорах Huawei Ascend 910B.

GLM-4.7 — это апгрейд декабрьского релиза 2025 года, переосмысленный для нового стека. По данным компании, hallucination rate у новой версии упала с 90% до 34% по сравнению с предыдущим поколением. На SWE-Bench Verified модель набирает 73,8% — лучший результат среди open-source моделей. На LiveCodeBench — 84,9%, опережая Claude Sonnet 4.5.

Архитектура железа

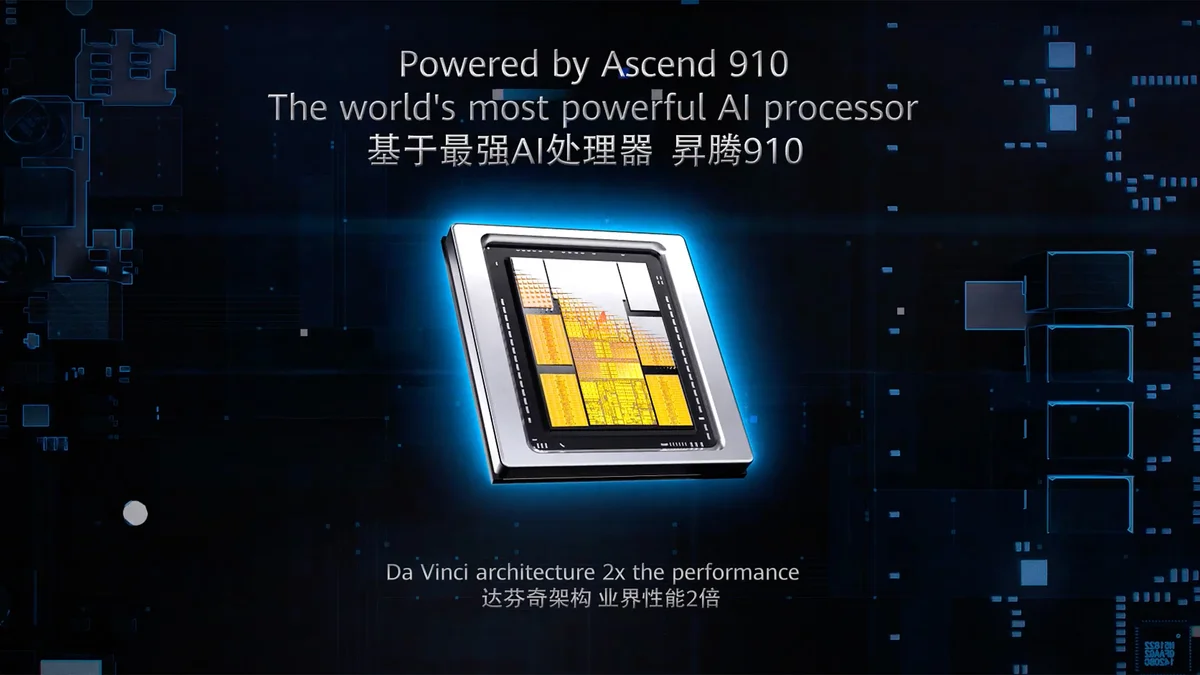

Фото: Tom's Hardware / Future Publishing — пресс-материалы Huawei

Фото: Tom's Hardware / Future Publishing — пресс-материалы Huawei

Huawei Ascend 910B — это чип, разработанный HiSilicon (дочка Huawei) и произведённый SMIC по техпроцессу 7 нанометров с использованием DUV-литографии (без EUV, к которому Китай не имеет доступа). Один чип выдаёт около 320 TFLOPS FP16 — это между Nvidia A100 (312 TFLOPS) и H100 (989 TFLOPS dense FP16).

В лоб H100 быстрее в 3 раза, но Zhipu решила эту проблему количеством. Кластер из 100 000 Ascend 910B по совокупной вычислительной мощности сопоставим с парком в 30–40 тысяч H100. Тренировка GLM-4.7 заняла, по данным компании, примерно на 15% больше времени, чем эквивалентный прогон на NVIDIA, — но цена Ascend ниже, и правительственные субсидии перекрывают разницу.

Сводка по железу:

- Чипы: Huawei Ascend 910B (HiSilicon design, SMIC fab, 7nm DUV)

- Производительность: ~320 TFLOPS FP16 на чип

- Размер кластера: 100 000 чипов

- Фреймворк: MindSpore (Huawei) вместо PyTorch/CUDA

- Time-to-train: +15% к NVIDIA-эквиваленту

MindSpore — невидимая половина истории

Самое интересное в этом стеке — не сами чипы, а программный слой. Подавляющее большинство frontier-моделей в мире тренируется на PyTorch поверх CUDA. У Huawei своего CUDA нет — есть CANN (Compute Architecture for Neural Networks), и свой фреймворк MindSpore.

По данным разбора стека, Zhipu и Huawei потратили большую часть 2025 года на портирование под этот стек. То, что в мире PyTorch занимает пару строк, в MindSpore приходится переписывать вручную: кастомные операции, distributed-тренинг, fused kernels для attention. Парадоксально, но именно эта необходимость переписывать всё с нуля привела к нескольким оптимизациям, которые Zhipu затем перенесла обратно в открытую часть стека.

Это объясняет, почему параллельный эксперимент DeepSeek с Huawei не пошёл: DeepSeek столкнулась с нестабильностью на больших прогонах и вернулась на NVIDIA для тренировки R2, оставив Ascend только для инференса. Разница не в чипах, а в том, сколько ресурсов команда готова потратить на стек поверх.

Сравнение метрик

| Бенчмарк | GLM-4.7 | Claude Sonnet 4.5 | GPT-5.2 |

|---|---|---|---|

| SWE-Bench Verified | 73,8% | 72,1% | 76,4% |

| LiveCodeBench | 84,9% | 82,3% | 88,1% |

| AIME 2026 I | 92,7% | 94,2% | 100% |

| Hallucination rate | 34% | 28% | 22% |

В лоб GPT-5.2 всё ещё впереди — особенно на математических бенчмарках вроде AIME. Но разрыв между «лучшая китайская модель без NVIDIA» и «лучшая модель планеты» сократился до однозначных процентов на большинстве задач. Год назад этот разрыв измерялся десятками процентов и казался непреодолимым.

Что это значит для экспортного контроля

Изначальная логика американских ограничений строилась на двух гипотезах. Первая — что Huawei Ascend физически не догонит NVIDIA по производительности. Вторая — что без CUDA китайские лаборатории не смогут эффективно использовать своё железо. GLM-4.7 опровергает обе.

Догнать NVIDIA на пиковой производительности на чип Huawei не сможет ещё долго — без EUV-литографии и без доступа к топовым 3 нм процессам это математически сложно. Но AI-тренинг — это не гонка одного чипа, а гонка кластеров. Если у тебя есть деньги и регулятор, который субсидирует электричество, ты можешь компенсировать отставание масштабом. А чтобы был эффективный стек поверх этого масштаба, нужна одна-две лаборатории, готовые потратить год на портирование. Zhipu это сделала.

Что дальше

Главный вопрос — насколько быстро остальные китайские лаборатории смогут повторить путь Zhipu. Alibaba (Qwen), Baidu (ERNIE), Moonshot — все они официально на Ascend в инференсе, но тренировка пока на смеси Nvidia + китайских чипов. С релизом GLM-4.7 у этих компаний появился рабочий референс. Один год — и стек, который казался экзотическим, может стать индустриальным стандартом для всего китайского AI-сектора.

Для всего мира это плохая новость в одном смысле и хорошая — в другом. Плохая: экспортный контроль работает медленнее, чем рассчитывали в Вашингтоне, и frontier-AI становится мультиполярным. Хорошая: появляется реальная конкуренция NVIDIA на рынке AI-чипов, и у других стран — Европа, Индия, Ближний Восток — возникает образец того, как строить независимый стек. До 2026 года это было «теоретически возможно». Теперь — задокументированно сделано.