AMD Instinct MI430X: 200 TFLOPs FP64 и обещание ×6 быстрее Nvidia Rubin

AMD анонсировала Instinct MI430X — HPC-ускоритель с более чем 200 TFLOPs FP64. По проекциям AMD, это в шесть раз больше, чем у будущего Nvidia Rubin, и фундамент суперкомпьютеров Discovery (ORNL) и Alice Recoque.

200 терафлопс FP64 на одном GPU. Шесть раз быстрее, чем у будущего Nvidia Rubin. Полтора десятка лет назад такие цифры выглядели бы как описание целого компьютерного зала. Сегодня AMD упаковала их в один ускоритель и поставила его в центр сразу двух национальных суперкомпьютеров — американского Discovery и европейского Alice Recoque.

Фото: AMD HPCUF 2026

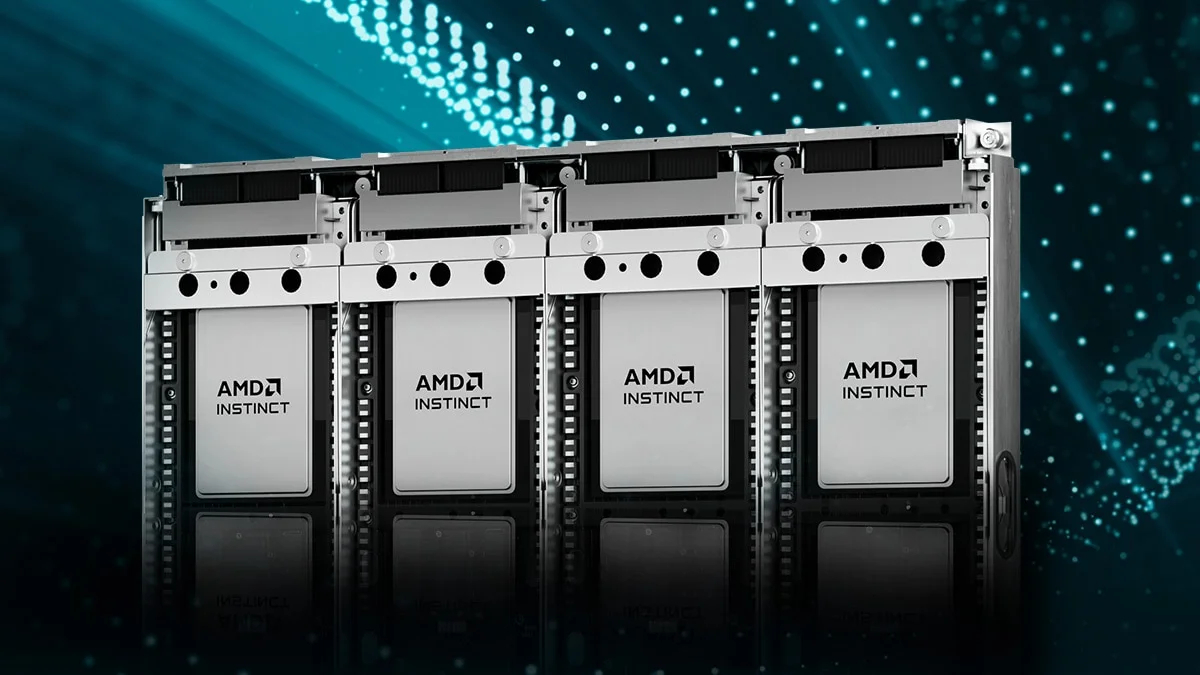

Фото: AMD HPCUF 2026

Что произошло

На HPC User Forum в Остине 5–6 мая AMD показала Instinct MI430X — новый GPU, спроектированный конкретно под научные вычисления. Главная цифра — больше 200 TFLOPs нативной FP64-производительности. Для сравнения: у Hopper-поколения было около 67, у Blackwell B200 порядка 80. AMD прямо заявляет, что MI430X обеспечивает «более чем шестикратное» преимущество над Nvidia Rubin — следующим поколением, которое Nvidia только готовит к выпуску.

Цифра агрессивная и опирается на инженерные проекции AMD по апрель 2026, а не на реальные тесты публикуемых продуктов. Но контекст важен: AMD не пытается бороться с Nvidia на поле LLM-инференса — там идёт MI355X с FP4/FP6 и параллельная подготовка MI450 на 432 ГБ HBM4. MI430X нацелен на другое — на симуляцию, моделирование и AI-for-science, где двойная точность всё ещё критична.

«Точность важна. FP64 — фундамент научных открытий. Конвергенция уже здесь — инфраструктура должна одновременно обслуживать HPC и AI-for-Science.»

— AMD, блог HPCUF 2026

Куда поедет MI430X

Параллельно с анонсом GPU AMD назвала две конкретные системы, которые он будет питать. Первая — Discovery, новый флагман Министерства энергетики США в Окриджской национальной лаборатории. Запуск намечен на 2028 год в рамках программы Genesis Mission, направленной на укрепление лидерства США в AI и HPC. Discovery комбинирует MI430X с EPYC следующего поколения и должен стать одним из первых «AI-фабричных» суперкомпьютеров страны.

Вторая система — европейская Alice Recoque, разворачиваемая по контракту с GENCI и CEA во Франции. Она спроектирована давать больше одного экзафлопса HPL и должна стать первым экзафлопсным суперкомпьютером Европы на территории Франции. Конкуренция в этом сегменте у AMD сейчас минимальная — Intel свернула Falcon Shores, Nvidia не предлагает специализированного FP64-решения, а ARM-only-варианты пока не дотягивают по программному стеку.

Ключевые характеристики MI430X:

- FP64 (Vector): >200 TFLOPs

- Сравнение с Nvidia Rubin: ×6 (по AMD-проекциям)

- Использование: HPC + AI-for-science (low precision и FP64 в одном пакете)

- Crown systems: Discovery (ORNL, 2028), Alice Recoque (GENCI, 2027)

- Превью на HPCUF Austin: 5–6 мая 2026

Зачем FP64 в эпоху FP4

Главный вопрос, который задают трейдеры и комментаторы под всеми постами AMD: «Это же эпоха FP4-инференса, кому нужен FP64?». Ответ AMD — научным симуляциям, на которых тренируются следующие поколения foundation-моделей. Климатические модели, квантовая химия, ядерная инженерия, биология белков, гидродинамика — всё это требует численной устойчивости, которую дают только 64-битные операции. Если AI-модели в ближайшие годы будут учиться на синтетических данных, сгенерированных симуляциями, то качество этих симуляций становится бутылочным горлышком.

Это та же логика, которой Nvidia подсветила Cosmos и которую DeepMind использует в Isomorphic Labs — но AMD заходит с противоположной стороны: не от модели, а от железа, которое генерирует данные.

Сравнение поколений (FP64, vector)

| GPU | FP64 (TFLOPs) | Год | Архитектура |

|---|---|---|---|

| Nvidia H100 | 67 | 2022 | Hopper |

| Nvidia B200 | ~80 | 2024 | Blackwell |

| AMD MI300X | 81 | 2023 | CDNA 3 |

| AMD MI355X | ~78 | 2025 | CDNA 4 |

| Nvidia Rubin | ~33 (по проекциям AMD) | 2026 | Rubin |

| AMD MI430X | >200 | 2026 | CDNA 4.5 |

После таблицы важная оговорка: цифра по Rubin взята из материалов AMD и опирается на публично раскрытые спецификации Nvidia, а не на финальный продукт. Когда Rubin выйдет в железе и пройдёт независимые тесты, расклад может измениться. Но даже с поправкой на маркетинг AMD получает редкое окно: впервые за десятилетие AMD заявляет лидерство в FP64 не на проценты, а в разы.

Что это значит

Для научных лабораторий и национальных суперкомпьютерных центров MI430X — реальный аргумент пересмотреть закупки. У AMD уже есть ROCm-стек, который работает на LUMI, El Capitan и Frontier; добавить MI430X — это эволюционный шаг, а не миграция платформы. Это объясняет, почему Discovery и Alice Recoque выбрали AMD до того, как чип был публично показан.

Для Nvidia это сигнал, что «GPU как универсальный ускоритель для всего» постепенно разваливается. Rubin строится под LLM-инференс и тренировку — там FP4/FP6 и massive HBM4. AMD занимает оставшееся поле: задачи, где двойная точность не опциональна. И, судя по амбициям с MI500 на CDNA 6 и HBM4E, уходить с этого поля AMD не собирается.

Выводы

MI430X — не флагман для GPT-обучения, и это его сила. AMD делает то, что у Nvidia становится побочной задачей: оптимизирует под классический научный счёт. ×6 vs Rubin — пока обещание на бумаге, но крепкое: за анонсом стоят два национальных контракта и реальный график поставок.

Для остальных это полезное напоминание, что AI-стек состоит не только из инференса. Если ваша работа — симуляции, climate-моделирование или CFD, в 2027–2028 годах основной выбор будет между MI430X и тем, что Nvidia успеет противопоставить отдельным FP64-SKU.