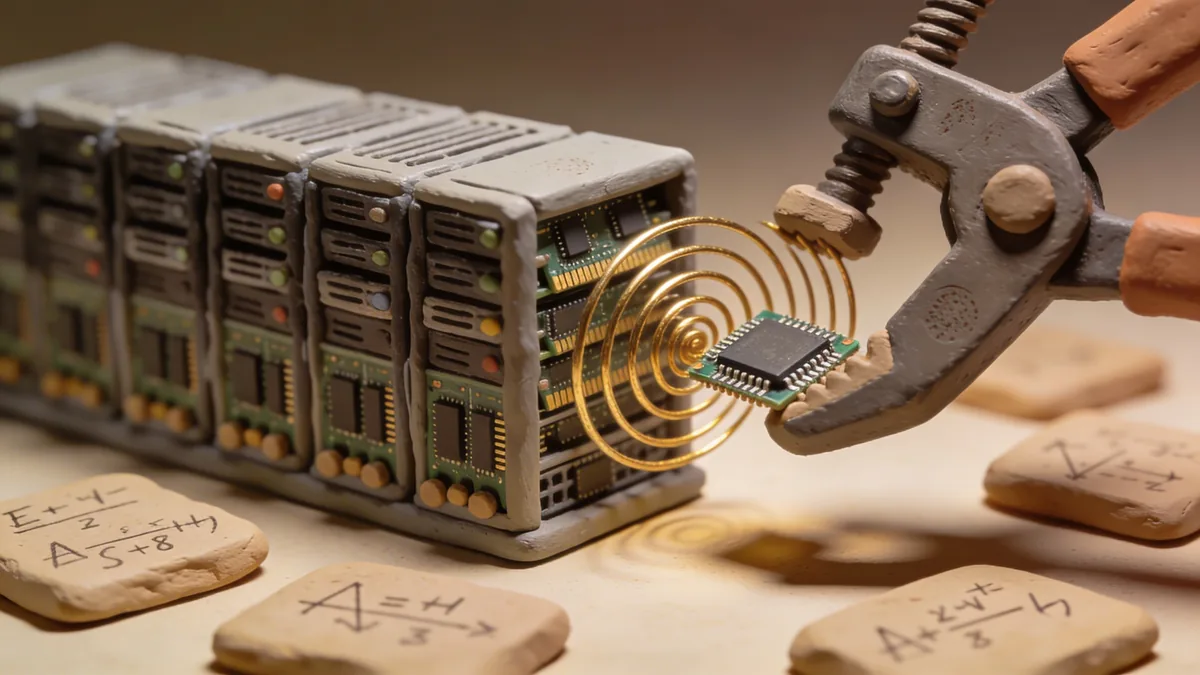

Google сжала память LLM в 6 раз — и обвалила акции чипмейкеров

TurboQuant от Google Research сжимает KV-кеш до 3 бит без потери точности. Акции SK Hynix, Samsung и Micron упали на 3-6%.

25 марта Google Research опубликовала алгоритм, который сжимает один из самых «прожорливых» компонентов языковых моделей в 6 раз — без потери точности. На следующий день акции трёх крупнейших производителей памяти упали на миллиарды долларов. CEO Cloudflare Мэтью Принс назвал это «Google's DeepSeek». А независимые разработчики выложили рабочие реализации на GitHub ещё до открытия бирж.

Что такое KV-кеш и почему он стоит так дорого

Когда языковая модель генерирует текст, она сохраняет промежуточные вычисления для каждого токена в так называемый Key-Value кеш. Чем длиннее контекст — тем больше этот кеш. Для модели с контекстом в 128K токенов KV-кеш может занимать десятки гигабайт GPU-памяти, и именно он часто становится узким местом: не вычисления, а память ограничивает количество одновременных запросов.

До TurboQuant существовали методы сжатия KV-кеша, но все они теряли точность при агрессивной квантизации. Сжатие до 4 бит работало приемлемо, но 3 бита и ниже давали заметную деградацию. Google утверждает, что решила эту проблему.

Как работает TurboQuant

Алгоритм основан на математически строгом подходе к векторной квантизации. Вместо того чтобы сжимать каждое значение независимо (как делает стандартная квантизация), TurboQuant работает с векторами целиком — используя методы из теории информации и рандомизированных проекций.

Ключевое свойство — алгоритм не требует обучения и не зависит от данных. Это значит, что его можно применить к любой модели без дообучения и без доступа к тренировочным данным. Просто берёте существующую модель, запускаете TurboQuant на её KV-кеше, и получаете 6-кратное сжатие.

На NVIDIA H100 это даёт до 8-кратного ускорения вычислений внимания — потому что сжатый KV-кеш быстрее читается из памяти. Статья была принята на ICLR 2026 в Рио-де-Жанейро.

Реакция рынка

Инвесторы отреагировали мгновенно. SK Hynix потерял 6%, Samsung — 5%, Micron — 3,4%. Логика простая: если модели требуют в 6 раз меньше памяти, то спрос на чипы памяти для AI-инфраструктуры должен упасть. Впрочем, эта логика сильно упрощена — TurboQuant сжимает только KV-кеш, а не веса модели и не весь inference pipeline.

| Компания | Падение акций | Рыночная реакция |

|---|---|---|

| SK Hynix | -6% | Крупнейшее дневное падение за 3 мес. |

| Samsung | -5% | Потеря ~$15 млрд капитализации |

| Micron | -3,4% | Снижение на фоне общего тренда |

Аналитики быстро указали, что паника преждевременна: общий объём GPU-памяти в дата-центрах продолжает расти, а TurboQuant скорее позволит запускать более длинные контексты на том же железе, чем покупать меньше памяти.

Споры вокруг RaBitQ

Не обошлось без скандала. На Reddit развернулась активная дискуссия о том, что TurboQuant использует идеи из метода RaBitQ — более ранней работы по рандомизированной бинарной квантизации. Авторы RaBitQ 26 марта формально направили свои замечания команде Google, указав на недостаточное цитирование и сходство подходов. Дискуссия быстро вышла за пределы академии и стала одной из самых горячих тем на r/LocalLLaMA с 596 очками и 89 комментариями.

Google пока официально не прокомментировала эти обвинения. Вопрос авторства в квантизационных методах — не новый: область развивается так быстро, что параллельные открытия случаются регулярно.

Что это значит для локальных LLM

Для энтузиастов, запускающих модели на потребительских GPU, TurboQuant — потенциально прорыв. Контекст в 128K токенов, который раньше требовал 48+ ГБ VRAM только для KV-кеша, теперь может уместиться в 8 ГБ. Это делает длинные контексты доступными на RTX 4070 вместо A100.

Реализации уже появляются: в llama.cpp и vLLM обсуждается интеграция, а несколько независимых проектов на GitHub уже предлагают рабочие прототипы. Если метод действительно даёт заявленные результаты без деградации — это одно из самых значимых улучшений для inference за последний год.