Siri научится видеть экран: что Apple готовит в iOS 26.4

Apple переизобретает Siri — ассистент получит осознание экрана и сможет выполнять действия в приложениях. Для обработки может использоваться Google Gemini.

Полтора года назад Apple пообещала три фундаментальных улучшения Siri на WWDC 2024: персональный контекст, осознание экрана и действия внутри приложений. С тех пор ни одно из них не появилось в релизной версии iOS. Судя по коду, обнаруженному журналистом Macworld Филипе Эспозито, всё это наконец приедет в iOS 26.4.

Что такое «осознание экрана»

Представьте: вы читаете статью в Safari, и Siri может видеть её содержимое. Не потому что вы скопировали текст и вставили в запрос, а потому что ассистент буквально воспринимает то, что отображено на дисплее.

На практике это означает, что вам больше не нужно объяснять Siri контекст. Открыта страница ресторана? Siri знает, о каком ресторане речь. Смотрите переписку? Siri понимает, о чём разговор. Это фундаментально меняет модель взаимодействия — вместо того чтобы формулировать запрос с нуля, пользователь продолжает диалог с учётом того, что уже видит.

Второе нововведение — действия внутри приложений. Siri сможет выполнять рутинные задачи, не заставляя пользователя вручную открывать нужное приложение и искать нужную кнопку. Это шаг от голосового поиска к полноценному AI-агенту, который умеет взаимодействовать с интерфейсом.

Роль Google Gemini

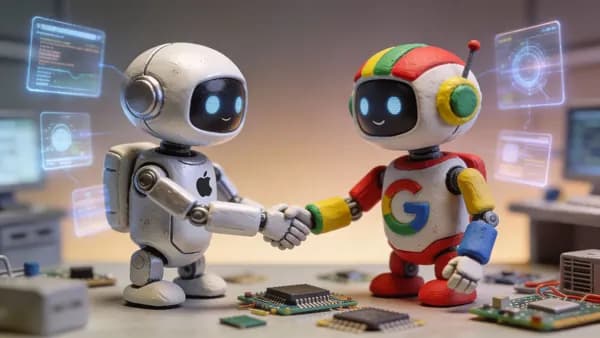

Любопытная деталь: Apple рассматривает возможность использования Google Gemini для обработки части запросов. Если это подтвердится, речь пойдёт о серьёзном архитектурном сдвиге. До сих пор Apple делала ставку на on-device обработку и собственные модели — ради приватности.

Компромисс может выглядеть так: данные отправляются через Private Cloud Compute от Apple, и Google не получает пользовательскую информацию напрямую. Это позволит задействовать мощности Gemini, сохраняя приватность — по крайней мере, на уровне маркетинговых обещаний.

Для Apple партнёрство с Google в AI — признание того, что собственных моделей недостаточно для конкуренции с тем, что предлагают ChatGPT и Gemini. Лучше использовать чужой движок за кулисами, чем проигрывать в качестве ответов.

Почему так долго

Изначально Apple планировала выпустить обновлённую Siri ещё в iOS 18.4. Не получилось — инженерные сложности оказались серьёзнее, чем ожидалось. Перенос на iOS 26.4 означает задержку более чем в год.

Причины понятны: осознание экрана — технически сложная задача. Ассистент должен не просто распознать текст на экране, а понять контекст: что это за приложение, какой тип контента отображается, какие действия доступны. Это требует интеграции на уровне операционной системы, а не просто нового API.

Что это меняет

Если Apple доведёт эти функции до релиза, Siri впервые за годы станет конкурентоспособным ассистентом. Осознание экрана — это та самая функция, которая отличает голосовой поисковик от AI-ассистента. Google уже реализовал нечто подобное с Gemini на Android, Samsung добавил аналогичные возможности в Galaxy AI.

Apple опаздывает, но у неё есть преимущество: контроль над всем стеком, от чипа до интерфейса. Вопрос в том, хватит ли этого, чтобы наверстать полтора года отставания.