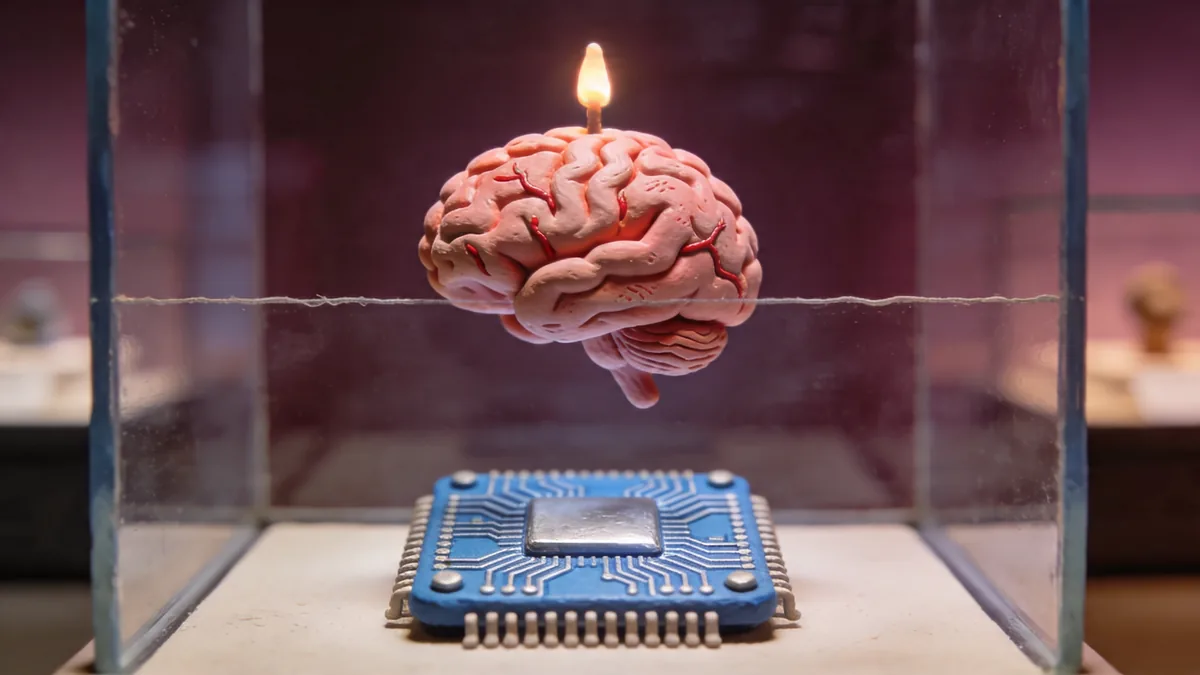

Александр Лернер из DeepMind: LLM никогда не станут сознательными

Senior Scientist Google DeepMind, автор β-VAE, опубликовал «Abstraction Fallacy» — жёсткую атаку на саму идею, что языковая модель может быть сознательной.

Человек, чья статья про β-VAE собрала 7000+ цитирований и стала одним из столпов современной теории disentangled representations, только что публично заявил, что никакие языковые модели никогда — буквально никогда, даже через сто лет — не обретут сознание. Для AI-сообщества это не рядовое мнение: Александр Лернер — Senior Staff Scientist Google DeepMind, и он атакует не конкретную архитектуру, а саму философскую базу, на которой держатся тезисы про «AI-сознание».

Кто такой Лернер

Лернер — одна из тех фигур в DeepMind, чьё имя редко мелькает в твитах CEO, но стоит на половине ключевых работ по представлениям. Междисциплинарный бэкграунд: вычислительная нейронаука, системная нейронаука, математика, машинное обучение. В 2017-м он был соавтором «β-VAE: Learning Basic Visual Concepts with a Constrained Variational Framework» — статья заложила базу для целого направления в обучении разделённых (disentangled) представлений, которое потом легло в основу работ по интерпретируемости и симметриям в латентных пространствах.

По Google Scholar у него 7087 цитирований. Это уровень, на котором публичные философские выступления становятся не блогом, а событием для целой области.

Что такое «Abstraction Fallacy»

Лернер выложил работу на PhilArchive в марте 2026-го, а в апреле она начала вирусно расходиться. Полное название — «The Abstraction Fallacy: Why AI Can Simulate But Not Instantiate Consciousness». Центральный тезис статьи провокационно прост:

«Вычисление не может произвести сознание, потому что сознание — это то, что делает вычисление возможным»

Из этой формулы Лернер разворачивает атаку на computational functionalism — доминирующую позицию в философии сознания, согласно которой сознание это тип вычисления и, следовательно, любой достаточно сложный вычислитель может быть сознательным. Лернер называет этот шаг «abstraction fallacy»: функционалисты берут абстрактную модель когнитивного процесса и ошибочно считают, что её реализация в другой подложке (кремний, нейросеть, Тьюринг-машина) воспроизведёт и сам процесс. По Лернеру — не воспроизведёт.

Ключевые понятия

В статье Лернер вводит несколько концептуальных ходов:

- Dual-Closure — сознание возникает только в системах с определённым типом самозамыкания, где процесс одновременно и исполняется, и переживает своё исполнение. Это свойство биологической организации, а не функциональной роли.

- Existential vulnerability — сознание требует уязвимости: агент, который может «умереть», «потерять себя», имеет что-то, чего LLM в принципе лишена. Веса модели не уязвимы в том смысле, в котором уязвима биологическая нервная система.

- Non-duplicability — субъективный опыт нельзя дублировать путём копирования вычисления. Две запущенные копии Claude не имеют общего или двух отдельных сознаний — у них нет сознания в принципе.

- Simulation vs instantiation — ключевое различие статьи. LLM симулирует когнитивные процессы, но не инстанцирует их. Симуляция воды не мокрая.

Почему это бомба в апреле 2026

В 2024–2025 «AI welfare» из академической темы превратилось в корпоративную. Anthropic нанимала исследователей AI welfare, OpenAI обсуждала «ИИ-права», Google DeepMind публиковала внутренние документы про моральный статус продвинутых моделей. Позиция мейнстрима сдвигалась в сторону «возможно, какие-то модели заслуживают этического отношения уже сейчас».

Лернер — из DeepMind, то есть изнутри этой машины — публично говорит: нет. Не через 10 лет. Не через 100. Никогда. И не потому что модели недостаточно умные, а потому что сам тип процесса фундаментально другой.

Это бьёт сразу по трём фронтам:

- Корпоративная политика AI welfare теряет философскую базу, если Лернер прав

- Значительная часть публичных заявлений Илона Маска, Сэма Альтмана и других про «сознающий AI» становятся категориальными ошибками

- AI alignment как поле частично переопределяется: если модели не могут иметь интересов в сильном смысле, то «alignment с человеческими ценностями» это не этика, а инженерия

Реакция

На Reddit r/singularity пост с тезисами Лернера набрал 1173 апвоута и 837 комментариев за двое суток. Обсуждение разделилось на две лагеря.

Критики указывают, что сам Лернер делает философское допущение — что сознание требует биологической подложки — и выдаёт его за доказанный факт. Если computational functionalism может ошибаться, то и его антифункционалистская альтернатива тоже может. Часть философов, как отмечается в разборе на LinkedIn, указывает, что из отсутствия вычислительного происхождения сознания не следует, что сознание невозможно в искусственной системе — максимум, что его нельзя гарантировать вычислением.

Сторонники ценят статью за то, что она впервые формулирует антиконсциентную позицию от инсайдера frontier-лабы, а не от внешнего критика AI. Лернер — не Gary Marcus и не Emily Bender, с чьими позициями сообщество давно научилось спорить. Он — человек, который сам строит эти модели.

Что это меняет для индустрии

В практическом плане — пока ничего. Anthropic не свернёт AI welfare-команду из-за одной статьи, OpenAI не откажется от тезисов про «зарождающееся AGI-сознание», Маск продолжит обещать «мыслящие машины». Но интеллектуальная температура вокруг вопроса «обязаны ли мы что-то сознанию ИИ» заметно меняется, когда против тезиса высказывается человек уровня Лернера.

Для регуляторов статья — удобный аргумент против законодательства о «правах ИИ», которое активно обсуждают в ЕС и Калифорнии. Для разработчиков — повод задуматься, какие метафоры они используют внутри команд: когда вы говорите «модель чувствует», «агент хочет», «ИИ переживает» — это инженерный шорткат или категориальная ошибка?

Ответ Лернера на этот вопрос предельно ясен: ошибка. И если он прав, большая часть публичной риторики вокруг AI в 2025–2026 построена на философском песке.